چطور فایل robots.txt وردپرس خود را برای سئو بهینه سازی کنیم

آیا میخواهید فایل robots.txt خود را بهینه کنید؟ درمورد چگونگی و اهمیت انجام این کار برای سئو اطلاع ندارید؟ اگر چنین است مقاله ما را مطالعه کنید تا درمورد نحوه بهینه سازی فایل robots.txt و میزان اهمیت این کار از نظر سئو آگاهی پیدا کنید.

درمورد میزان اهمیت این فایل برای سئو باید بگوییم فایل robots.txt نقش مهمی در عملکرد کلی سئو سایت شما بازی میکند. این فایل اساسا به شما امکان برقراری ارتباط با موتورهای جستجو و آگاه کردن آنها از قسمتهایی که باید ایندکس کنند را میدهد.

آیا واقعا به فایل robots.txt احتیاج دارم؟

عدم وجود فایل robots.txt موتورهای جستجو را از کاوش و ایندکس سایت شما بازنمیدارد. با این حال به شدت توصیه میشود که یک فایل robots.txt در سایت خود داشته باشید. بطور مثال اگر بخواهید نقشه سایت XML خود را به موتورهای جستجو معرفی کنید، این کار را باید در فایل robots.txt انجام دهید؛ مگر اینکه قبلا آن را در ابزار Google Webmaster معرفی کرده باشید.

ما به شدت توصیه میکنیم که اگر تاکنون فایل robots.txt را روی سایت خود ایجاد نکردهاید، هرچه سریع تر نسبت به انجام این کار اقدام کنید.

فایل robots.txt کجاست؟ چطور یک فایل robots.txt ایجاد کنم؟

فایل robots.txt معمولا در دایرکتوری ریشه سایت شما قرار دارد. برای مشاهده آن لازم است که توسط FTP client یا با استفاده از Cpanel به فایلهای سایت خود دسترسی پیدا کنید.

این فایل تنها یک فایل متنی ساده است و شما میتوانید آن را بوسیله یک ویرایشگر متن مانند notepad باز کنید.

اگر فایل robots.txt را در دایرکتوری ریشه سایت خود ندارید، هم اکنون میتوانید آن را به سایت خود اضافه کنید. تمام کاری که لازم است انجام دهید این است که یک فایل متنی روی دسکتاپ کامپیوتر خود ایجاد کنید و آن را با نام robots.txt ذخیره کنید. سپس به آسانی آن را به پوشه ریشه خود آپلود کنید.

مقاله مرتبط: 9 مورد از بهترین پلاگین ها و ابزارهای وب برای سئو که باید از آنها استفاده کنید

چطور از فایل robots.txt استفاده کنیم

فرمت استفاده شده برای فایل robots.txt بسیار ساده است. خط اول معمولا یک نام مقابل User-Agent نوشته شده. User-agent در واقع نام ربات جستجویی است که سعی در برقراری ارتباط با این فایل را دارد. برای مثال، این نام میتواند Googlebot یا Bingbot باشد. میتوانید در اینجا علامت * را قرار دهید تا شامل تمام رباتهای موجود شود.

خط بعدی مربوط به allow و disallow کردن محتواها برای موتورهای جستجو است؛ که از طریق این دستورات موتورهای جستجو میفهمند کدام قسمت از سایتتان را باید ایندکس کنند و از کدام قسمت باید صرف نظر کنند.

در زیر نمونهای از این فایل را مشاهده میکنید:

User-Agent: * Allow: /wp-content/uploads/ Disallow: /wp-content/plugins/ Disallow: /readme.html

در مثال بالا از فایل robots.txt، به تمام رباتها اجازه داده شده تا دایرکتوری آپلود تصاویر را ایندکس کنند.

در خط بعد به رباتها اعلام شده که دایرکتوری پلاگینها و فایل readme.html را ایندکس نکنند.

بهینه سازی فایل robots.txt شما برای سئو

در دستورالعملهایی که به مدیران وبسایتها ارائه میشود، گوگل به آنها توصیه میکند که از فایل robots.txt برای مخفی کردن محتواهایی که کیفیت پایین دارند، استفاده نکنند. اینکه بخواهید از فایل robots.txt برای متوقف ساختن گوگل از ایندکس دسته بندیها، دادهها و سایر صفحات بایگانی استفاده کنید، انتخاب هوشمندانهای نیست.

به یاد داشته باشید، هدف استفاده از فایل robots.txt این است که رباتها را برای کاوش محتوای سایتتان راهنمایی کنید. نه اینکه آنها را از انجام این کار منع کنید.

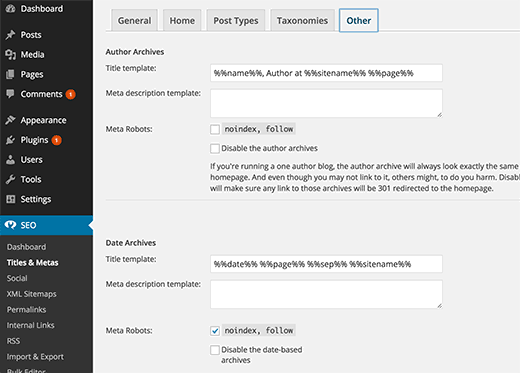

افزونههایی وجود دارند که به شما امکان افزودن متا تگهای nofollow و noindex را به صفحات بایگانی میدهد. افزونه سئو وردپرس نیز به شما امکان انجام این کار را میدهد. البته ما توصیه نمیکنیم قابلیت ایندکس را از صفحات بایگانی بردارید اما اگر میخواهید این کار را انجام دهید بهترین راه آن استفاده از افزونه است.

نیازی نیست که در فایل robots.txt صفحه ورود، دایرکتوری ادمین یا صفحه ثبت نام را noindex کنید زیرا این متا تگها بصورت خودکار توسط وردپرس به صفحات ثبت نام یا ورود اضافه میشوند.

توصیه میشود که در فایل robots.txt خود، فایل readme.html را disallow کنید. زیرا این فایل میتواند برای کسانی که سعی در کشف نسخه وردپرس استفاده شده در سایت شما را دارد مفید باشد. البته شخصی که بخواهد میتواند به سادگی بوسیله مرورگر به این فایل دسترسی پیدا کند.

به عبارت دیگر اگر اشخاصی با یک دستور مخرب سعی در انجام یک اتک انبوه و یافتن سایتهایی با ورژن وردپرس خاص را داشته باشند، تگ disallow میتواند سایت شما را از این اتک محافظت کند.

همچنین باید دایرکتوری پلاگینهای خود را نیز disallow کنید. این کار نیز میتواند برای امنیت سایت شما مفید باشد زیرا در صورتی که اشخاصی برای انجام اتک به دنبال افزونه آسیب پذیر خاصی در سایتها باشند نمیتوانند به سایت شما دست پیدا کند.

مقاله مرتبط: سئوی محلی برای وردپرس: چگونه رنکینگ جستجوی محلی خود را افزایش دهیم

افزودن نقشه سایت XML به فایل robots.txt

اگر از افزونه سئو یواست یا سایر افزونههای مشابه که نقشه سایت XML را تولید میکنند، استفاده میکنید، افزونه شما بصورت خودکار برای افزودن خطوط مربوط به نقشه سایت به فایل robots.txt تلاش میکند.

اما اگر افزونه نتواند بصورت خودکار این کار را انجام دهد، یک لینک مانند چیزی که در زیر آمده به شما ارائه میدهد که میتوانید بصورت دستی آن را به فایل robots.txt خود اضافه کنید:

Sitemap: http://www.example.com/post-sitemap.xml Sitemap: http://www.example.com/page-sitemap.xml

یک فایل robots.txt ایده آل باید چگونه باشد؟

بسیاری از وبلاگها و وبسایتهای محبوب از فایلهای robots.txt ساده ای استفاده میکنند که بسته به نیاز وبسایت ممکن است به صورت زیر باشد:

User-agent: * Disallow: Sitemap: http://www.example.com/post-sitemap.xml Sitemap: http://www.example.com/page-sitemap.xml

این فایل robots.txt به سادگی به تمام روباتها اجازه ایندکس و کاوش تمام محتوای وبسایت را میدهد و شامل لینک نقشه سایت xml است.

در زیر مثال دیگری از فایل robots.txt آمده که برای استفاده در سایت وردپرس به دلایلی که ذکر شد مناسب تر میباشد.

ser-Agent: * Allow: /?display=wide Allow: /wp-content/uploads/ Disallow: /wp-content/plugins/ Disallow: /readme.html Disallow: /refer/ Sitemap: http://www.wpbeginner.com/post-sitemap.xml Sitemap: http://www.wpbeginner.com/page-sitemap.xml Sitemap: http://www.wpbeginner.com/deals-sitemap.xml Sitemap: http://www.wpbeginner.com/hosting-sitemap.xml

امیدواریم این مقاله جهت آموزش بهینه سازی فایل robots.txt برای سایت وردپرستان مفید بوده باشد. اگر دیدگاه یا سوالی دارید زیر همین پست کامنت بگذارید.